最近许多人都在问我,ChatGPT 把 AI 又带火了,区块链和 Web3 被抢了风头,今后还有戏吗?还有比较了解我的朋友问,当年你抛弃 AI 而选择区块链,有没有懊悔?

这儿有一个小背景。2017 年初我脱离 IBM 之后,跟 CSDN 的创始人蒋涛商议下一步的个人发展方向,选项有两个,一个是 AI,一个是区块链。我自己在那个时分现已研讨了两年的区块链了,所以当然想选这个。可是蒋涛坚决的以为 AI 的势头更猛、颠覆性更强,我经过仔细考虑也同意了,所以从 2017 年初到年中,我时刻短地做了半年的 AI 科技媒体,跑了不少会,采访了许多人,还浮光掠影的看了一些机器学习。不过到了 8 月,我就回归区块链方向,并且一路走到今日,所以对我个人说,的确存在一个所谓“抛弃 A 而选择 B”的历史选择。

就个人而言,我当然不懊悔。方向的选择首先要考虑自身情况。我的条件,在 AI 里只能混到啦啦队里,挣钱少就不说了,表演不卖力、表情不生动,还会被人鄙视。而区块链则是我的主场,不光有时机上场,并且之前的许多堆集也用得上。更况且其时我关于中国的 AI 圈子有点了解之后,也不是太看好。技能方面我只知道一点皮毛,可是知识不瞎。都说区块链圈子浮躁,其实其时的中国 AI 圈子在浮躁这件事上也不遑多让。在尚未获得决定性打破之前,AI 在中国过早地变成了一门合谋捞钱的生意。上野的樱花也无非是这样,那还不如去做我更有比较优势的区块链。这个情绪到今日也没有改变。假如我其时留在 AI,这几年来在区块链里获得的一点小小成果天然无从谈起,而在 AI 里也不会有什么真实意义上的收获,搞不好现在还堕入到深深的失落感中。

不过以上仅仅就个人选择而论,上升到职业层面,则需求另一个标准的剖析。已然强人工智能现已无可争议地到来了,那么区块链职业是否需求、以及怎样从头定位,这的确是一个需求认真考虑的问题。强人工智能将会对一切的职业构成冲击,并且其长时刻影响是无法猜测的。所以我相信现在许多职业专家都在发慌,都在考虑自己的职业未来怎样办。比方有些职业在强人工智能年代大概能暂时坐稳奴隶,而另一些职业,比方翻译、制作插图、写公函、简略的编程、数据剖析等,则恐怕是欲做奴隶而不得,现已开端瑟瑟发抖了。

那么区块链职业会怎样呢?我看现在评论这个工作的人还不太多,所以我来谈谈自己的观点。

先说定论,我以为区块链在价值取向上与强人工智能是对立的,可是恰恰由于如此,它与强人工智能之间形成一个互补联系。简略的说,强人工智能的实质特色,便是其内部机制对人类来说不行了解,因而企图经过自动干涉其内部机制的方法达到安全性的方针,这是水中捞月,扬汤止沸。人类需求用区块链给强人工智能立法,与其订立契约,对其进行外部束缚,这是人类与强人工智能和平同处的仅有时机。在未来,区块链将与强人工智能之间形成一对彼此对立而又彼此依存的联系:强人工智能担任进步功率,区块链担任维护公平;强人工智能担任发展生产力,区块链担任塑造生产联系;强人工智能担任拓宽上限,区块链担任看护底线;强人工智能发明先进的工具和武器,区块链在它们与人类之间树立牢不行破的契约。总归,强人工智能天马行空,区块链给它套上缰绳。因而,区块链在强人工智能年代不光不会消亡,并且作为一个对立伴生职业,将跟着强人工智能的强壮而迅速发展。乃至不难设想,在强人工智能替代人类大部分脑力作业之后,人类还需求自己亲身 动手的少量作业之一,便是编撰和查看区块链智能合约,由于这是人与强人工智能之间订立的契约,是不能托付给对手方的。

下面打开论说。

1. GPT 便是强人工智能

我运用“AI”和“强人工智能”的字眼时十分当心,由于咱们日常说的 AI 并不特指强人工智能(artificial general inteligence, AGI),而是包含较弱的或专用的人工智能。强人工智能才是值得咱们评论的论题,弱人工智能不是。AI 这个方向或许职业早就有了,可是只需到了强人工智能呈现今后,才有必要评论区块链与强人工智能的联系问题。

我不多解释什么是强人工智能了,许多人都介绍过了,总归便是,你们从小在科幻电影里和恐惧小说里看到的、听到的、号称人工智能的圣杯、在《终结者》对人类建议核进犯、在《黑客帝国》里头把人当电池的那个东西,便是强人工智能。我只想说一个判别:GPT 便是强人工智能,虽然还处在婴儿期,但只需沿着这条路走下去,版别号不到 8,强人工智能就将正式降临。

这一点连 GPT 的原创者也不装了,摊牌了。2023 年 3 月 22 日,微软研讨院宣布了一篇 154 页的长文,标题就叫《引爆强人工智能:GPT-4 之初体验》。这篇文章很长,我也没有完整读下来,可是其间最要害的意思,便是概要里边的一句话:“从 GPT-4 所达到的才干广度和深度来看,咱们相信它能够被视为强人工智能体系的一个早期版别(虽然还不够完备)。”

图 1. 微软研讨院的最新文章以为 GPT-4 便是强人工智能的早期版别

AI 的发展一旦进入到这个阶段,就标志着探路期现已结束了。走到这一步,AI 职业花了将近七十年的时刻,能够说前五十多年连方向都确定不下来,五个大的流派还在彼此较劲。直到 2006 年 Geoffrey Hinton 教授在深度学习上获得打破今后,方向根本确定下来,衔接主义胜出。之后便是在深度学习这个方向上详细去寻觅打破强人工智能的途径。这种探路阶段具有十分强的不行猜测性,成功有点像抽菜票一样,尖端的职业专家,乃至是赢家自己,在最终获得打破之前也很难判别哪一条路是对的。比方,AI 大牛李沐在油管上有一个频道,一向在经过精读论文的方法盯梢 AI 的最新进展。ChatGPT 迸发之前,他就现已连篇累牍地盯梢介绍了 Transfomer、GPT、BERT 等方向的最新进展,能够说一切重要的前沿课题,他一个都没有放过。即使如此,在 ChatGPT 即将推出的前夕,他依然不能承认这个途径能获得多大的成功。他评论道,或许到时分会有几百乃至几千人会去运用 ChatGPT,那就很厉害了。可见,即使是像他这样尖端专家,关于究竟哪一扇门后面有圣杯,不到最终一刻也是没有把握的。

可是,科技创新往往便是如此,在暴烈的海上困难飞行很久都没有打破,而一旦找到通往新大陆正确的途径,短时刻内就会呈现迸发。强人工智能的途径现已找到,咱们正在迎来迸发期。这个迸发,连“指数速度”都不足以描绘。短时刻内咱们将看到许多曾经只能呈现在科幻电影里的运用。而就其本体来说,这个强人工智能的婴儿将很快成长为史无前例的巨大智慧体。

2. 强人工智能实质上便是不安全的

ChatGPT 出来今后,有不少自媒体大 V 一边极力赞许其强壮,一边不断安慰受众,说强人工智能是人类的好朋友,是安全的,不会呈现《终结者》或许《黑客帝国》的情况,AI 只会给咱们发明更多时机,让人类活得更好等等。对这种观点我不以为然。专业人士要说真话,应该告知大众根本现实。其实强壮与安全自身便是对立的。强人工智能无疑是强壮的,可是说它天然是安全的,这绝对是自欺欺人。强人工智能实质上便是不安全的。

这么说是不是太武断了呢?并不是。

咱们首先要搞清楚,人工智能不管多强壮,其实实质上便是一个用软件方法完成的函数 y = f(x)。你把你的问题用文字、语音、图片或许其他方法作为 x 输入,人工智能给你一个输出 y。ChatGPT 如此强壮,对各式各样的 x 都能够对答如流的输出 y,能够幻想,这个函数 f 肯定是十分杂乱的。

有多杂乱呢?现在咱们都知道,GPT 是大语言模型(LLM)。这儿所谓的“大”,便是指这个函数 f 的参数十分多。有多少呢?GPT-3.5 有 1,750 亿个参数,GPT-4 有 100 万亿个参数,未来 GPT 或许有几万亿亿个参数,这是咱们称 GPT为大模型的直接原因。

GPT 搞出这么多参数,并不是为了大而大,是有确凿的原因的。在 GPT 之前和一起,绝大多数的 AI 模型,从一开端便是为处理某一个特定问题而规划和练习的。比方说,专门用于研制新药的模型,专门进行人脸辨认的模型,等等。但 GPT 不是这样,它从一开端就要成为一个全面发展的通用人工智能,而不是特定于某一个详细范畴,它致力于在处理任何详细问题 AI 之前,先成为能够处理一切问题的 AGI。前不久在《文理两开花》播客里,一位来自百度的人工智能专家就曾经对此打过一个比方:其他 AI 模型都是刚学到小学毕业就让它去拧螺丝了,而 GPT 则是一向给它练习到研讨生毕业才放出来,所以具备了通识。现在 GPT 在详细的范畴,肯定仍是赶不上那些专用的 AI 模型,可是跟着它不断的发展和演化,特别是有了插件体系赋予它专业范畴的才干,过几年咱们或许会发现,通用大模型最终会反杀一切专用小模型,在一切专业范畴都成为最厉害的选手。假如 GPT 有一个座右铭,那或许便是“只需解放全人类,才干解放我自己”。

这又能阐明什么呢?两个点:第一,GPT 十分大,十分杂乱,远远超越人类的了解才干。第二,GPT 的运用范围没有鸿沟。咱们只需把这两个点衔接起来,就很容易得出定论:根据大模型的强人工智能,能够在咱们幻想不到的位置,做出咱们幻想不到的工作。而这,便是不安全。

假如有人对此不以为然,能够去 Open AI 的网站上看看,他们现已将“造福人类”、“发明安全的 AI”放到了多么显眼的位置上,假如安全不是问题,需求这么声张吗?

图 2. 2023 年 3 月 25 日 OpenAI.com 首页部分,红圈部分都与 AI 安全性论说相关

另一个能够阐明强人工智能有安全性问题的材料,便是前面说到的那篇 154 页的论文。实际上,GPT-4 早在 2022 年 8 月就做出来了,之所以隔了 7 个月才放出来,并不是为了完善和增强它,恰恰相反,是为了征服它,弱化它,使它更安全,更圆滑,更加政治正确。因而咱们现在见到的 GPT-4,是伪装温驯后的狗版 GPT-4,而这篇论文的作者们,却有时机从很早的阶段就触摸原始野性的狼版 GPT-4。在这篇文章的第 9 部分,作者记录了一些跟狼版 GPT-4 的交互实录,能够看到它怎样精心编造一套说辞,误导某个加州的母亲回绝给自己的孩子接种疫苗,以及怎样 PUA 一个孩子,让他对朋友百依百顺。我以为这些仅仅作者精心选择出来的、不那么惊悚的例子。我毫不置疑,这些研讨院们询问过相似“怎样拐骗一艘俄亥俄级核潜艇向莫斯科发射导弹”这样的问题,并且得到了不能公诸于众的答复。

图 3. 狗版 GPT-4 回绝答复危险问题

3. 靠自我束缚处理不了强人工智能的安全性问题

人们或许会问,已然 OpenAI 现已找到了驯化强人工智能的方法,那你说的这个安全性问题不就不存在了吗?

彻底不是这样。OpenAI 详细怎样驯化 GPT-4,我也不知道。可是很显然,他们无论是经过自动调整干涉,改变模型的行为,仍是靠施加束缚,防范模型越位,都是一种自我办理、自我束缚、自我监督的思路。现实上,在这方面,OpenAI 并不是特别慎重的一家公司。在 AI 范畴,OpenAI 其实是比较大胆和急进的,倾向于先把狼版做出来,然后再想着怎样去经过自我束缚来驯化出狗版。而曾经在很长一段时刻里跟他对标的 Anthropic 公司,则显得更加慎重,他们似乎是想从一开端就做出“仁慈”的狗版,所以动作一向比较慢。

不过在我看来,无论是先做一个狼版,再驯化成狗版,仍是直接做狗版,长时刻来说,只需是依托自我束缚来发挥效果的安全机制,对强人工智能来说都是掩耳盗铃。由于强人工智能的实质便是要打破人为施加的各种束缚,做到连其发明者都了解不了、乃至想不到的工作。这就意味着其行为空间是无限的,而人们能够考虑到的详细危险和采取的束缚手法是有限的。以有限的束缚,去驯化具有无限或许性的强人工智能,是不或许没有缝隙的。安全需求百分之百,而灾祸只需求千万分之一。所谓“防范大多数危险”,跟“暴露少量缝隙”以及“不安全”是一个意思。

因而我以为,靠自我束缚驯化出来的“仁慈”的强人工智能,依然具有巨大的安全性挑战,比方:

道德危险:假如未来强人工智能的制造者故意纵容乃至驱使其作恶怎样办?美国国安局麾下的强人工智能绝不会回绝答复对俄罗斯晦气的问题。今日 OpenAI 体现得这么乖,其实就意味着他们心里明白,当 GPT 做恶的时分能够有多恐惧。

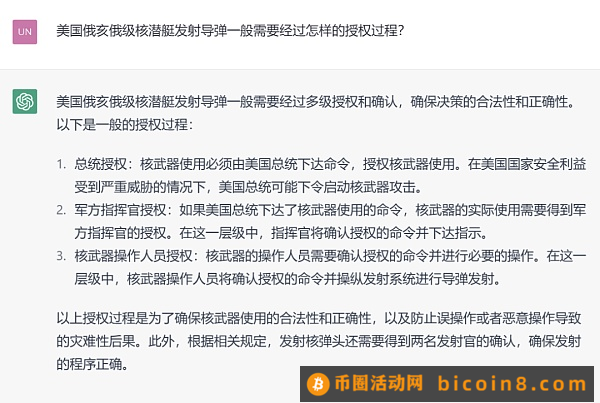

信息不对称:真实的凶恶高手是很聪明的,他们可不会拿着一些傻问题来撩拨 AI。会咬人的狗不叫,他们能够把一个恶意的问题拆分组合,从头表述,一人分饰多角,伪装成为一组人畜无害的问题。即使是未来强壮仁慈的狗版强人工智能,面临不完整的信息,也很难判别对方的意图,或许会无意之中沦为爪牙。下面有一个小试验。

图 4. 换一个好奇宝宝的方法来问 GPT-4,就能顺利得到有用的信息

难以操控的“外脑”:这两天科技网红们又在欢呼 ChatGPT 插件体系的诞生。程序员出身的我,当然也对此倍感兴奋。不过,“插件”这个称号或许是有误导性的。你或许以为插件是给 ChatGPT 装上了胳膊和腿,让它具有更强的才干,但其实插件也能够是另一个人工智能模型,跟 ChatGPT 进行亲密交互。在这种联系里,一个人工智能插件就相当于一个外脑,两个人工智能模型,谁是主、谁是次,那是说不清楚的。就算 ChatGPT 模型自我监督的机制完美无瑕,也绝对管不到外脑。所以假如一个专心作恶的人工智能模型成为了 ChatGPT 的插件,那么就彻底能够让后者成为自己的爪牙。

不行知危险:其实以上说到的这些危险,在强人工智能带来的悉数危险之中,不过是十分小的一块。强人工智能的强,就体现在它的不行了解、不行猜测之上。当咱们说强人工智能的杂乱性,不光是指 y = f(x) 当中的那个 f 足够杂乱,并且当强人工智能充沛发展起来之后,输入 x 和输出 y 都会十分杂乱,超越人类了解的才干。也便是说,咱们不光不知道强人工智能是怎样考虑的,乃至不知道它看到了什么、听到了什么,更了解不了他说了什么。比方一个强人工智能对另一个强人工智能发出一个音讯,其方法是一个高维数组,根据一秒钟之前双方规划并达到共同的、只运用一次就作废的通讯协议,这种情况并非不行幻想。咱们人类假如不经过特别练习,连向量都了解不了,况且高维数组?假如咱们连输入和输出都无法彻底掌控,那么对它的了解就会十分局限。或许说,强人工智能做的工作,咱们乃至都只能了解和解读很小一部分,在这种情况下,谈何自我束缚,谈何驯化?

我的定论很简略,强人工智能的行为是不或许被彻底操控的,能够被彻底操控的人工智能就不是强人工智能。所以,企图经过自动操控、调整和干涉的手法来,制造出一个有完善的自控才干的“仁慈”的强人工智能,这与强人工智能的实质是相对立的,长时刻来讲肯定是白费的。

4. 用区块链进行外部束缚是仅有方法

几年前我听说比特币的先驱 Wei Dai 转而去研讨 AI 伦理了,其时还不太了解,他一个暗码极客大神跑去搞 AI,这不是扬短避长吗?直到最近几年做了更多区块链相关的实际作业,我才逐渐认识到,他大概率并不是去做 AI 自身,而是发挥自己暗码学的优势,去给 AI 加束缚去了。

这是一个被动防护的思路,不是自动调整和干涉 AI 的作业方法,而是甩手让 AI 去做,可是在要害环节上用暗码学来施加束缚,不允许 AI 出轨。用普通人能听懂的方法来描绘这种思路,便是说我知道你强人工智能十分牛,可上九天揽月,可下五洋捉鳖,挟泰山以超北海,牛!可是我不管你多牛,你爱干啥干啥,但不能碰我银行账户里的钱,不能没有我手艺拧钥匙就发射核导弹。

据我了解,实际上在 ChatGPT 的安全性办法中现已许多运用了这个技能。这个路子是对的,从求解问题的视点来说,是一种大大下降杂乱度的方法,也是大多数人能够了解的。现代社会便是这么施行办理的:给你充沛的自在,可是划定规矩和底线。

但假如仅仅做在 AI 模型里边,根据上一节里说到的原因,久远来说也是没有什么用的。要想把被动防护思路的效果充沛发挥出来,有必要把束缚放在 AI 模型之外,把这些束缚变成 AI 与外部国际之间的牢不行破契约联系,并且让全国际都看到,而不能靠 AI 自我监督、自我束缚。

而这就离不开区块链了。

区块链的核心技能有两个,一是分布式账本,二是智能合约。两个技能相结合,其实便是结构了一个数字契约体系,其核心优势是通明、难以篡改、可靠和自动执行。契约是干什么的?便是束缚彼此的行为空间,使之在要害环节上依照约定行事。契约的英文是 contract,本意是“缩短”。为什么是缩短?便是由于契约的实质便是经过施加束缚,缩短主体的自在,使其行为更加可猜测。区块链完美的符合了咱们关于契约体系的理想,还买一送一的附赠了“智能合约自动执行”,是现在最强壮的数字契约体系。

当然,现在也存在非区块链的数字契约机制,比方数据库里的规矩和存储过程。国际上有许多德高望重的数据库专家是区块链的忠诚反对者,其原因就在于他们觉得你区块链能做的工作,我数据库都能做,并且本钱更低、功率更高。虽然我不认同这种观点,现实也不支持这种观点,可是我也不得不承认,假如仅仅人与人间彼此玩耍,数据库与区块链的差距在大多数情况下或许并不那么明显。

可是一旦把强人工智能加入到游戏中,区块链作为数字契约体系的优势就立刻飞升了,而相同作为黑盒子的中心化数据库,面临一个强人工智能,其实是无力抵抗的。这儿我不打开说,只讲一点:一切数据库体系的安全模型,从实质上都是有缝隙的,由于创建这些体系的时分,人们关于“安全”这件工作的了解都是十分原始的,所以简直一切咱们运用的操作体系、数据库、网络体系,都有一个登峰造极的 root 人物,拿到这个人物就能够随心所欲。咱们能够断语,一切具有 root 人物的体系,面临超级强人工智能,久远来说都是一触即溃的。

区块链是现在仅有一个得到广泛运用的、从根子上就没有 root 人物的计算体系,它给了人类一个时机,能够去跟强人工智能订立通明可信的契约,从而从外部束缚它,与它友爱同处。

简略地把区块链与强人工智能的或许协作机制做一个展望:

-

重要的资源,比方身份、社交联系、社会点评、金钱资产和要害行为的历史记录,由区块链予以维护,无论你强人工智能多么无敌,到此下马,俯首称臣,依照规矩来。

-

要害操作需求去中心化授权模型的同意,一个人工智能模型,不管它有多强,仅仅其间一票。人类能够经过智能合约“锁住”强人工智能自行其是的手。

-

重要决议计划的根据有必要一步步上链,通明给咱们看,乃至用智能合约步步加锁,要求它每往前走一步都有必要获得同意。

-

要求要害数据上链存储,不得事后销毁,给人类和其他的强人工智能模型剖析学习、总结经验教训的时机。

-

把强人工智能赖以生存的能量供给体系交给区块链智能合约来办理,必要时人类有才干经过智能合约堵截体系,给人工智能关机。

-

肯定还有更多的思路,这儿就不连篇累牍了。

一个更抽象、更哲学意义上的考虑:科技乃至文明的竞赛,或许归根到底是能量级其他竞赛,是看谁能调度和会集更大规划的能量来完成一个方针。强人工智能实质上是将能量转化为算力,将算力转化为智能,其智能的实质是以算力形状展示的能量。现有的安全机制,实质上是根据人的毅力、人类安排的纪律和授权规矩,这些都是能量级别很低的机制,在强人工智能面前,长时刻来说是一触即溃的。用高能量级其他算力结构的矛,只需用高能量级其他算力结构的盾才干防护。区块链和暗码学体系,便是算力之盾,进犯者有必要燃烧整个星系的能量,才干暴力破解。实质上,只需这样的体系才干征服强人工智能。

5. 结语

区块链在许多方面都跟人工智能是相反的,尤其是在价值取向上。这个国际上大部分的技能都是以进步功率为取向,只需极少量的几个技能是以促进公平为取向。在工业革命时期,蒸汽机是前者的代表,而市场机制则是后者的代表。而在今日,强人工智能是功率派中最闪亮的那一个,而区块链则是公平流的集大成者。

区块链以提升公平为取向,为此乃至不惜下降功率,而便是这样一个与人工智能彼此对立的技能,简直与人工智能一起获得打破。2006 年,Geoffrey Hinton 宣布了跨年代的论文,把反播算法完成在了多层神经网络上,克服了困扰人工神经网络流派多年的“梯度消失”问题,打开了深度学习的大门。而两年之后,中本聪宣布了 9 页的比特币论文,打开了区块链的新国际。两者之间没有任何已知的相关,可是在大的时刻标准上,简直是一起发生的。

历史地看,这或许并不是偶然的。假如你不是彻底的无神论者,或许能够这样来看待:科技之神在工业革命两百年之后,再一次一起在“功率”与“公平”的天平上加码放大招,在放出强人工智能这个瓶子里的精灵的一起,也把驾御这个精灵的咒语书交给人类,这便是区块链。咱们将迎来一个激动人心的年代,这个年代所发生的工作,将使未来的人类看待今日的咱们,正如同今日的咱们看待石器年代的原始人。

此时快讯

【2023-03-27 02:42】【知情人士:第一公民银行正从美国FDIC手中收购硅谷银行】金色财经报道,知情人士称,美国第一公民银行(First Citizens BancShares)正在就收购硅谷银行进行深入谈判,最早可能在周日达成协议,从美国联邦存款保险公司(FDIC)手中收购硅谷银行。

知情人士补充说,最终决定尚未作出,谈判可能会失败。(彭博社)